近日,有不同国家的多组开发人员在研究一些新东西,他们将OpenAI的大型语言模型 (LLM) GPT的多个实例,串在一起来创建了一些“自主”AI系统,这些系统可以自己做很多事情,例如在没有干预的情况下执行一系列任务如编写、调试、开发自己的代码,甚至根据运行反馈来修复自己在书面输出中的错误。

简而言之就是,用一个主AI来控制更多副AI,在更少人类干预的情况下,完成更多的工作任务。

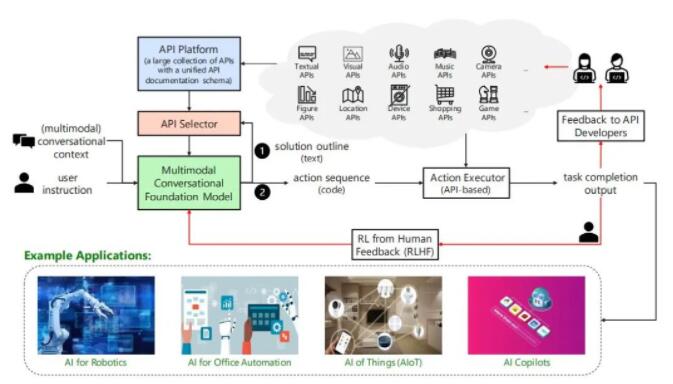

与仅仅提示ChatGPT为应用程序生成代码不同,任何有权访问OpenAI系统公共版本的人目前都可以做这件事,这些“自主”AI会给多个“代理”AI下命令,让其进行协同工作,如开发网站、创建时事通讯、编译在线页面来响应用户查询等等,以及完成其他需要由多个步骤和迭代过程组成的任务。

在GitHub上流行的“Auto-GPT”就是这样一个自主AI程序。它是由游戏开发人Toran Bruce Richards所开发的一款实验性开源应用程序,内置GPT-4语言模型,可以实现一定意义的自主运行,可以根据实时反馈,自主改进自己的运行方式。开发者认为这类应用“突破了AI可能性的界限”,因为它可以将GPT4的推理应用于更广泛、更复杂的问题,这些问题往往需要长期规划和多个步骤才能完成。

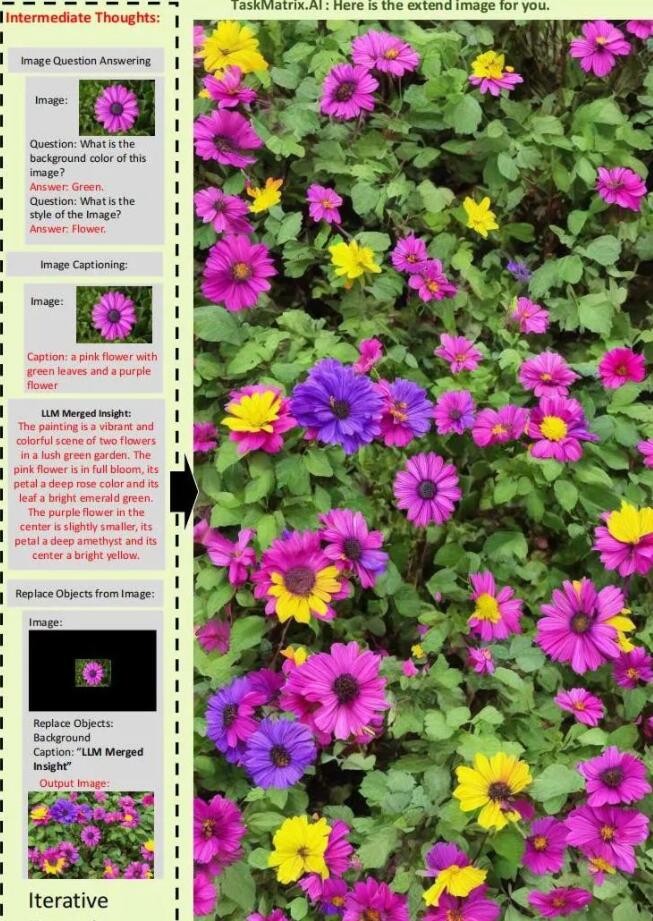

比如下面这个案例:给它一朵花,直接还你一片花海;再比如以前需要手动修改AI写过的方案,现在可以直接让AI帮忙订正,还可以直接要求其完成配图及排版,诸如此类。

曾有一段演示Auto-GPT的视频展示了开发人员为其设定的目标:展示其编码能力、改进一段代码、测试它、自行关闭并将其输出写入文件。于是该程序创建了一个待办事项列表,它将阅读代码添加到它的任务中,并在编写输出后关闭自己,然后一项一项地完成它们。

Richards还发布了另一个视频,来展示Auto-GPT如何进行谷歌搜索和摘取新闻文章,以了解有关某个主题的更多信息,从而开展一项可行性业务。值得一提的是,该程序在谷歌搜索时,会请求用户允许它继续下一步。根据Auto-GPT GitHub的警告,不要使用“连续模式”,因为它“有潜在危险,可能导致你的AI永远运行;或执行你会执行的操作,但是会绕过你的授权。”

Auto-GPT并不是“AI控制AI”方向的唯一成果。Untapped Capital的风险投资合伙人和名为Yohei Nakajima的开发人员创建了一个“任务驱动的自主代理”,它由GPT-4、矢量数据库Pinecone,以及一个由LLM提供支持的应用程序框架LangChain组成。据开发者描述:这个系统能够完成任务,并根据完成的结果生成新任务,并实时确定任务的优先级。

这些自主AI系统是通往真正人工智能研究的第一步,目的是让模型模拟思维链、推理和自我反省,以完成一系列任务及子任务。正如东北大学和麻省理工学院的研究人员最近发表的一篇论文中所说,开发者是使用一个“自我反思”的LLM,来帮助另一个LLM驱动的AI代理,在不丢失前置情节的情况下完成任务。

好在所有开发者都非常清醒,尽量少的人工干预是Auto-GPT等自主AI系统的重要价值,但它们必须确保是在人类道德和法律范围内运作,同时尊重隐私和安全问题应该是一个优先事项。

Auto-GPT的诞生,是否意味着我们很快即将进入人工通用智能的世界?电影中AI统治人类的世界是否快要来了?对此,OpenAI的开发人员兼联合创始人Andrej Karpathy曾表示:将AI模型相互堆叠,以完成更复杂的任务,并不意味着我们即将看到通用人工智能的出现,这些例子甚至不能完全证明GPT-4是可以“自治的”。

但正如我们所见,它确实能让系统持续运行,极大地提高了现有AI自我反省和自我批判的能力,并以更少的资源完成任务人为干预和监督,就目前来看,其导向仍然是积极的。

版权声明 | 文章整理自网络,仅供学习参考,版权归属原作所有

如有问题,请及时与我们联系,我们将第一时间做出处理

作者:无私向斑马

2023-10-15 22:23:32

作者:无私向斑马

2023-10-15 22:23:32

Android版下载

Android版下载